阿里巴巴已于近日发布全新 AI 模型 QwenLong-L1-32B,一款基于强化学习(RL)优化的长上下文推理模型。

根据介绍,QwenLong-L1-32B 的最大亮点在于其惊人的 13 万个 Token 上下文长度。这一能力使其能够处理超大规模的文本输入,轻松应对复杂、多层次的信息整合任务。相比传统模型,QwenLong-L1-32B 在长上下文处理上实现了从短上下文到长上下文推理能力的无缝迁移,展现了强大的泛化能力。

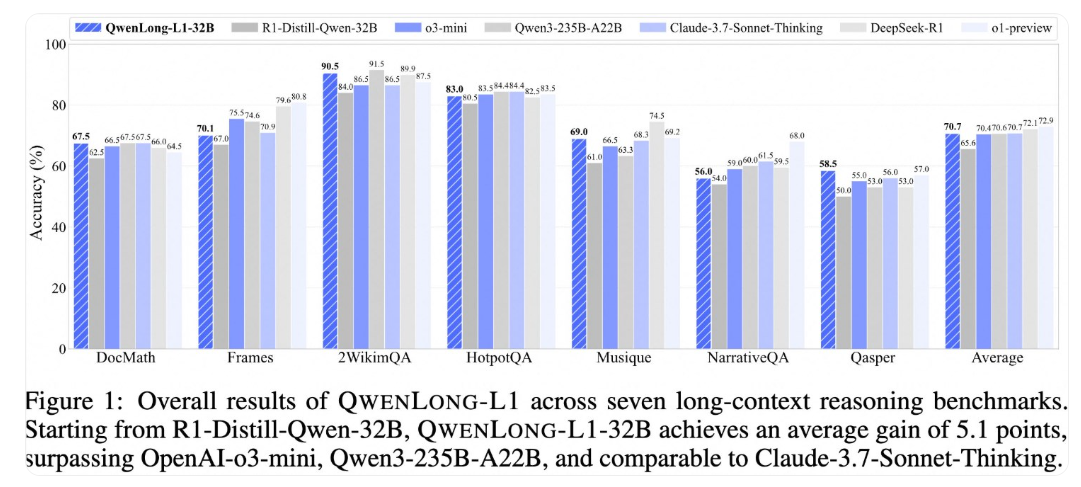

在七项长上下文问答(DocQA)基准测试中,QwenLong-L1-32B 展现了非凡的实力。其性能不仅超越了 OpenAI 的 o3-mini 模型和阿里巴巴自家的 Qwen3-235B-A22B,甚至接近了 Claude-3.7-Sonnet-Thinking 的水平。这一成绩彰显了阿里巴巴在长上下文推理领域的深厚技术积累。

QwenLong-L1-32B 专为处理高复杂度任务设计,适用于以下场景:

- 多段文档综合分析:能够高效整合多篇文档的信息,提取关键点并进行深入分析。

- 跨文档跳跃推理:在多个文档间进行逻辑推理,快速捕捉关联信息。

- 金融、法律与科研场景:为需要高精度推理的复杂领域提供强大支持,例如合同分析、财务报表解读和学术研究。

QwenLong-L1-32B 基于强化学习(RL)技术进行优化,通过先进的算法设计,成功实现了从短上下文到长上下文的推理能力迁移。这种创新方法不仅提升了模型的性能,还为其在多样化场景中的应用奠定了坚实基础。