闻乐发自凹非寺

量子位 | 公众号 QbitAI

开源大模型正在进入中国时间。

Kimi K2 风头正盛,然而不到一周,Qwen3 就迎来最新升级,235B 总参数量仅占 Kimi K2 1T 规模的四分之一。

基准测试性能上却超越了 Kimi K2。

Qwen 官方还宣布不再使用混合思维模式,而是分别训练 Instruct 和 Thinking 模型。

所以,此次发布的新模型仅支持非思考模式,现在网页版已经可以上线使用了,但通义 APP 还未见更新。

Qwen 官方还透露:这次只是一个小更新!大招很快就来了!

但总归就是,再见 Qwen3-235B-A22B,你好Qwen3-235B-A22B-2507了。

By the way,这个名字怎么取得越来越复杂了。

先来看看这次的“小更新”都有哪些~

增强了对 256K 长上下文的理解能力

新模型是一款因果语言模型,采用 MoE 架构,总参数量达 235B,其中非嵌入参数为 234B,推理时激活参数为 22B。

在官方介绍中显示,模型共包含 94 层,采用分组查询注意力(GQA)机制,配备 64 个查询头和 4 个键值头,并设置 128 个专家,每次推理时激活 8 个专家。

该模型原生支持 262144 的上下文长度。

这次改进主要有以下几个方面

- 显著提升了通用能力,包括指令遵循、逻辑推理、文本理解、数学、科学、编码和工具使用。

- 大幅增加了多语言长尾知识的覆盖范围。

- 更好地符合用户在主观和开放式任务中的偏好,能够提供更有帮助的响应和更高质量的文本生成。

- 增强了对 256K 长上下文的理解能力。

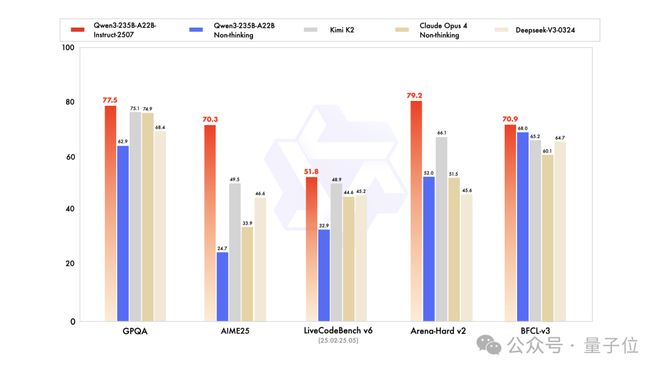

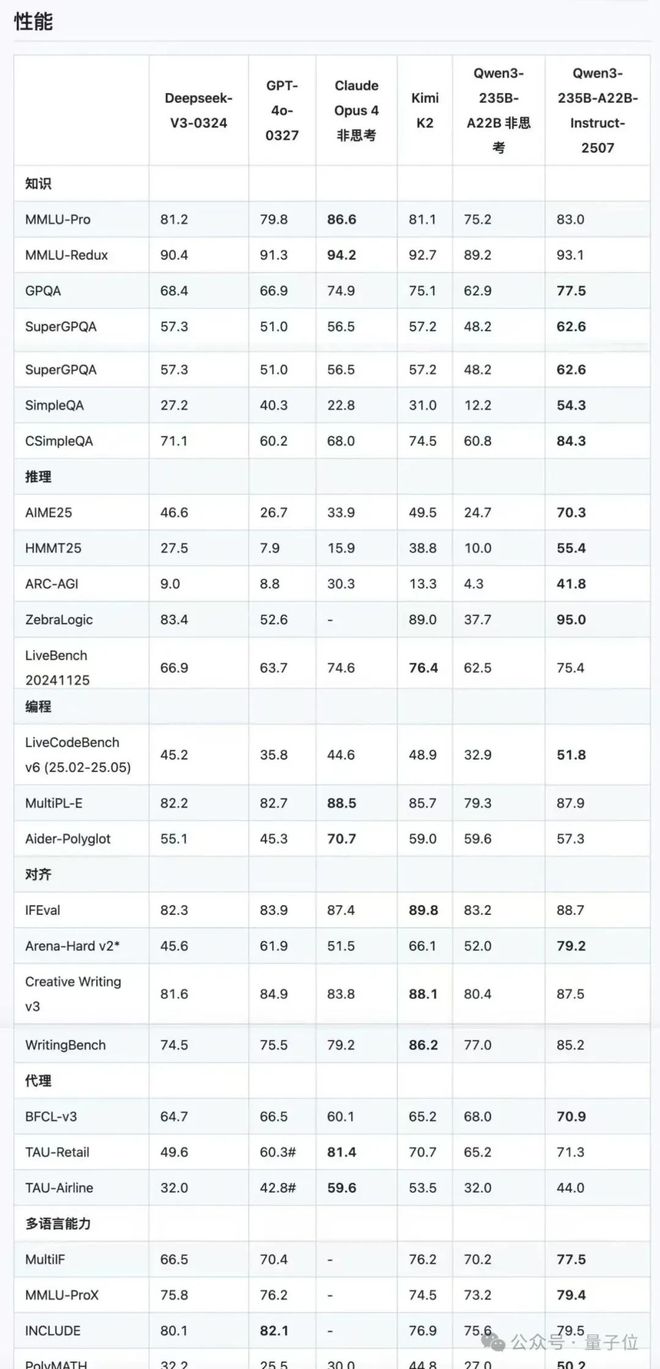

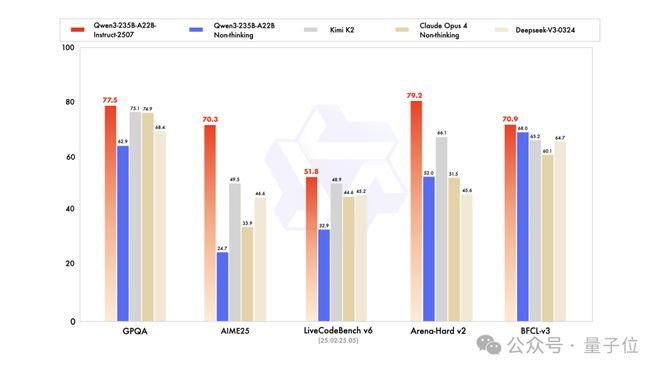

在官方发布的基准测试中可以看到,相较于上一版本,新模型在 AIME25 上准确率从 24.7% 上升到 70.3%,表现出良好的数学推理能力。

而且对比 Kimi K2、DeepSeek-V3,Qwen3 新模型的能力也都略胜一筹。

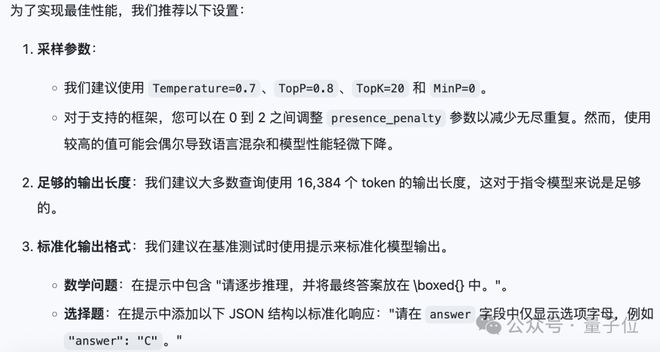

为了提高使用体验,官方还推荐了最佳设置:

Qwen3 新版本深夜发布就立刻收获了一众好评:Qwen 在中等规模的语言模型中已经领先。

也有网友感慨 Qwen 在开启新的架构范式:

One More Thing

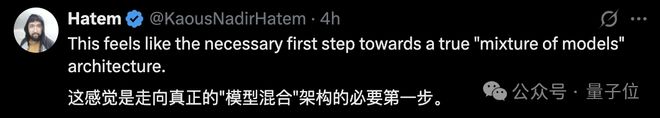

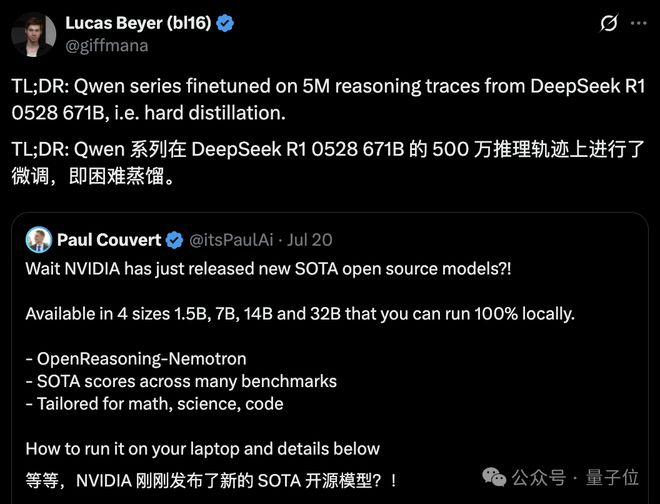

有趣的是,就在 Qwen3 新模型发布的前两天,NVIDIA 也宣称发布了新的 SOTA 开源模型 OpenReasoning-Nemotron

该模型提供四个规模:1.5B、7B、14B 和 32B,并且可以实现 100% 本地运行。

但实际上,这只是基于 Qwen-2.5 在 Deepseek R1 数据上微调的模型。

而现在 Qwen3 已经更新,大招已经被预告。

随着 Llama 转向闭源的消息传出,OpenAI 迟迟不见 Open,开源基础大模型的竞争,现在正在进入中国时间。

DeepSeek 丢了王座,Kimi K2 补上,Kimi K2 坐稳没几天,Qwen 的挑战就来了。

[1]https://x.com/Alibaba_Qwen/status/1947344511988076547

[2]https://x.com/giffmana/status/1947362393983529005

— 完 —