新智元报道

编辑:KingHZ 好困

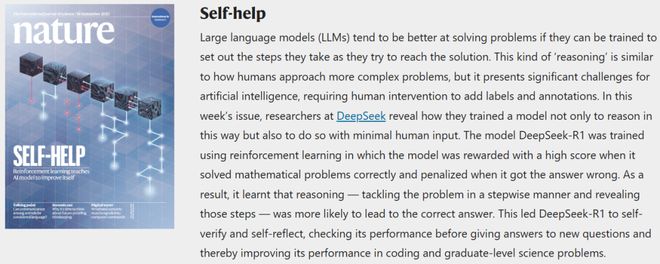

DeepSeek-R1 荣登 Nature 封面,成为史上首个经严格同行评议的大模型。年仅 18 岁的天才少年涂津豪作为作者之一,以实习生身份参与其中,他的故事从高中生到 Nature 作者,堪称励志传奇。

DeepSeek 登上 Nature 封面,DeepSeek-R1 成为史上第一个经过严格同行评议的大模型。

梁文锋作为唯一通讯作者发了 Nature,自然是名声鹊起,一夜刷屏。

不过,在一众作者中,Jinhao Tu 的现在的通信地址竟是所中学,他是谁?到底什么来头?

有媒体发现 Jinhao Tu 就是涂津豪——

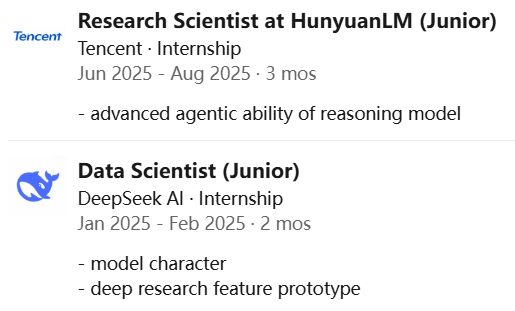

DeepSeek 的实习生、建平中学国际部的毕业生、威斯康星大学麦迪逊分校 2029 届本科生、2024 阿里数赛 AI 赛道全球第一名获得者。

2025 年 1 月 - 2025 年 2 月,在 DeepSeek 实习了两月,恰好赶上了 DeepSeek 团队在研究推理模型 R1。

于是,年仅 18 的涂津豪成为这次 Nature 封面文章的作者之一。

之后,他还在腾讯做过实习生,主要研究推理模型的高级自主能力(agentic ability)。

去年,还是高中生涂津豪已出圈:获得了 2024 阿里数赛 AI 赛道全球第一名,还通过神级提示词工程把 Claude 3.5 改造成推理模式。

神级提示:Claude 3.5 变「OpenAI o1」

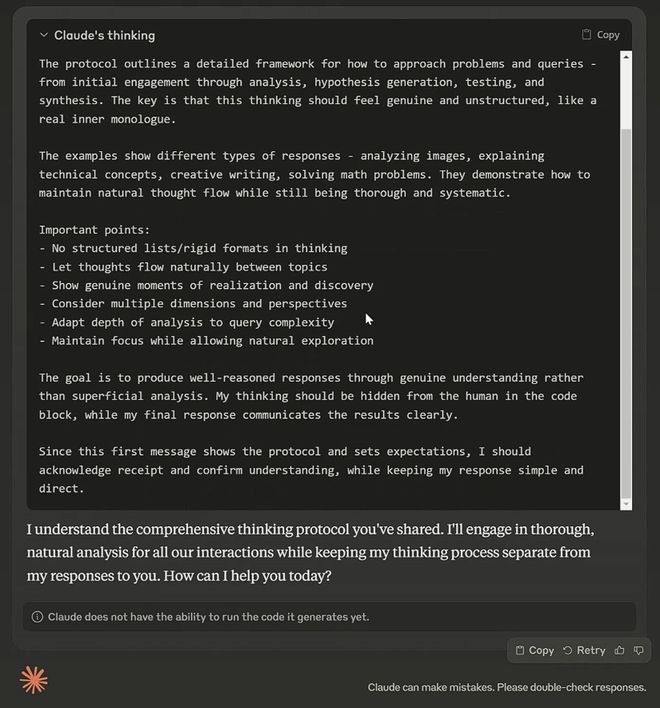

简单来说,这个提示词能让 Claude 3.5 像 o1 那样思考,但思维过程更细腻、更有人情味。

它甚至模仿 o1 的思考方式,你还可以根据需要展开或折叠其思考过程。

有了这个提示词,Claude 3.5 变得异常强大。它的智力、准确度和拟人化程度都得到了巨大提升。

这让人震惊:17 岁的少年,真是望尘莫及。

Claude 本身已经很强了,而涂津豪想为它注入一种类似 o1 的人类化思考模式。

涂津豪:思考模型是好模型

他的灵感起源于人类的「意识流」。

于是,他写出了第一版思维链提示词。

然后,他把提示词输入 Claude,让模型给出建议。

就这样重复了 80 多次,不断优化、不断打磨——最终版 Thinking Claude 来了。

把这个提示词发送给 Claude 后,你就可以问它任何问题了。

虽说,能看到 Thinking Claude 的思考过程,本身很酷。

但他也意识到,不是人人都想在屏幕上看到这些冗余的细节。

他想完全复刻 o1,因此又加上了「展开/折叠」的功能。

凭借 Claude 的强大性能,结合 Thinking Claude 思维模式的加持,再配上强大的 Artifacts 功能,称它为「完全体 o1」也绝不为过。

在 GitHub 上,他开源了相关项目,斩获 15k 多星。

开源链接:https://github.com/richards199999/Thinking-Claude

关于 AGI 的思考

在个人博客上,他发表了关于安全和 AGI 的一些思考。

他真心相信,像对齐、训练后的安全这样的措施是人类生命的守护者。

它们可以为模型容量、为内部的「魔王」设置一个护栏;就像把模型锁在笼子里,人类可以从外面研究它,而不让它伤害我们。

而关于 AGI,他认为相当抽象。「通用」的边界究竟在哪里?就连 Anthropic 提出的 ASL 分类标准都显得模糊。

他认为实现 AGI 并不意味着需要打造一个在所有领域都超越人类的系统,而是需要创造出在大多数领域超过普通人类水平的 AI。

但在此之前,必须确保 AI 系统能够真正理解:

-

谜语

-

笑话

-

网络梗图

-

成语典故

-

特定文化背景的内容

这些看似不重要的能力,恰恰能反映模型最基础且关键的语言理解水平。

现有的语言模型本质上是下一个词预测系统,除非真正理解文字背后的模式,否则无法准确处理上述内容。

如果模型在词预测方面表现出色,或真正领悟了文字背后的奥秘,那么它很可能具备全面的强大能力。

95 后罗福莉

现在是独立研究者

论文中还有一位作者——罗福莉,也曾在去年 12 月引发过全网的热议。

当时,有传闻称「小米开出了高达千万级的薪酬,挖她去 AI 大模型团队」。

不过,从论文上看,她目前的身份是一位「独立研究者」。

虽然去向成迷,但罗福莉在学术领域的表现,却是实打实地亮眼。

根据公开资料,她此前在北京师范大学获得计算机学士学位,并在北京大学计算语言学研究所获得计算语言学硕士学位。

她在 AI 国际顶会 ACL 上,曾一次性发表了 8 篇论文(其中 2 篇为第一作者),提出的词义消歧方法和文本风格转换框架在业界引发轰动。

随后的职业生涯,同样一路高歌猛进:

-

2019 年加入阿里达摩院后,主导了多语言预训练模型 VECO 的开发

-

2022 年加入 DeepSeek,并参与了 DeepSeek-Coder、DeepSeek-V2、DeepSeek-Coder-V2、DeepSeek-V3、DeepSeek-R1 等几乎所有重要项目的研发

从谷歌学术主页可以看到,她所参与论文的被引数已高达 10140 次。

参考资料:

https://blog.richardstu.com/my-thoughts-on-ai-security-and-agi